���ڙC��ҕ�X��܉����ͨ�ԄӜy���о�

�r�g��2022��04��27�� ����ƌW(xu��)���g(sh��)Փ�� �Δ�(sh��)��

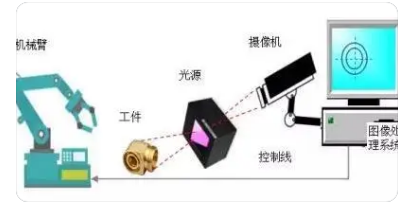

����ժҪ������еă��v��܇֮�g���ְ�ȫ�ľ��x�DZ�����܇β�¹ʰl(f��)������Ҫ�l�������ڙC��ҕ�X�@�õĈD��(sh��)��(j��)��Ϣ�S�������Ը���(j��)�ɼ����ĈD���M(j��n)�ж��ļ��əz�y���������������һ�N���ڙC��ҕ�X����܇�y�����ԓ��������܇�ɗl܉����׃���g��(1 435 mm)�������(zh��n)����������܇֮�g���x��ԓ�������þ��e��(j��ng)�W(w��ng)�j(lu��)����Ŀ���C�ɼ����ĈD���M(j��n)��̎���ͷ�������ȡ�����܉���������ٻ������е�С�׳���ԭ���ƌ�(d��o)����������(bi��o)ϵ�c��������(bi��o)ϵ֮�g��ӳ���P(gu��n)ϵ���Ķ���(y��u)����܇֮�g���x��Ӌ��ʽ�����Y(ji��)���������y��ϵ�y(t��ng)���`����<6%������ϵ�y(t��ng)�y���r�g�� 40 ms ֮��(n��i)���f��ԓ�������F(xi��n)�˜y���c�ڈD���Ы@ȡ����������Ϣ��Ч���ں��c���ɣ������ڌ���܇�ƄӾ��x�M(j��n)���Дࡣ

�����P(gu��n)�I�~�����x�y��;�C��ҕ�X;��Ŀ���C;��ȌW(xu��)��(x��);�D��̎��;܉���z�y;С�׳���ԭ��;���e��(j��ng)�W(w��ng)�j(lu��)

�����S�����罛(j��ng)���Լ��ƌW(xu��)���g(sh��)�ĸ��ٰl(f��)չ���Ї�����܉����ͨҎ(gu��)ģҲ�������ӡ��S��܉����ͨ�������������Լ���܇�ٶȵ���ߣ���܇�ƄӾ��xҲ�S���T�Ե���������������ƄӾ��x�������ɵ���܇β�¹ʕr�аl(f��)��������܉����ͨ�\�еİ�ȫ���DZ��ϳ��о���ƽ�����е��P(gu��n)�I�������ǰ����܇֮�g�ľ��x�ͳɞ�����܇�\�а�ȫ����Ҫ������(bi��o)��(zh��n)����܇�g���y�������Լ��ٶ�Ҳ�Ȟ���Ҫ����(d��ng)��܇����^���г��F(xi��n)��̖�����ϻ��{(di��o)�Ȇ��}�r����܇�ĸ��ٶȺ��h(yu��n)���x������ʹ�ú��yͨ�^���ہ��(zh��n)�_��Ӌ�cǰ����܇β���ľ��x�����˱�����܇��������r�����ܰ�ȫ��܇����Ҫ��܇�y��ϵ�y(t��ng)��y���cǰ����܇܇β�ľ��x���������D(zhu��n)���ɿ�ҕ����(sh��)��(j��)���{�T�l(f��)���A(y��)�������y(t��ng)�Ĝy���ֶ��м���[1]�����_(d��)[1-4]������[5]�Ȃ��������g(sh��)�������ڂ��y(t��ng)�Ĝy���ֶΣ�ҕ�X��̖[6]��̽�y�������V��Ŀ��(bi��o)��Ϣ���������r���������͡�

�����īI(xi��n)[7]�����һ�N�����ں����_(d��)(���ھ��x�y��)�͈D�������(�����ϵK��z�y)���F·�ϵK��z�yϵ�y(t��ng)���S���C��ҕ�X���g(sh��)�İl(f��)չ�����H���ԏĈD���Ы@ȡ�ϵK����Ϣ��߀�������ÈD�F(xi��n)���x�Ĝy������˸���(y��ng)ԓʹ�ÙC��ҕ�X���g(sh��)�@�ø����m����ϵ�y(t��ng)���ɵ���Ϣ���īI(xi��n)[8]�A(y��)�y���ܽ�ͨϵ�y(t��ng)(Intelligent Traffic System��ITS)��ͨ�^�C��ҕ�X����֪�h(hu��n)���l�������^ȥ�Ď�����C��ҕ�X�y��ϵ�y(t��ng)Ҳ���V��ʹ������܇�I(l��ng)���īI(xi��n)[9]ͨ�^���b��܇β�ăɂ��z���^�������w�D���M(j��n)�ЈD��̎�����Ķ�Ӌ���c����܇�v֮�g�ľ��x��������܇֮�g�ľ��x��(sh��)��(j��)���r�@ʾ�o��܇�v���mȻԓ���������x��Ӌ��ֵ�ǜ�(zh��n)�_�ģ��������pĿ�z���^�y���㷨��(f��)�s�Ҙ�(bi��o)�����y��ʹ���pĿ�y��ϵ�y(t��ng)���t�^��

�����īI(xi��n)[10]ʹ����܇β���Ć��O(ji��n)�ؔz���^�팦�{�h(hu��n)���M(j��n)�з�����ͨ�^�D��̎��Ӌ����c��܇�v֮�g���������x���ٶȺͼ��ٶȡ���ԓ�����õ��Ĝy�����̺͜y�������h(yu��n)�����_(d��)������܉����ͨ����������Ļ��ڙC��ҕ�X�����һ�N���ζ����_�ķ�����Ŀǰ���چ�Ŀҕ�X�y��ķ�������܇܉���I(l��ng)��߀δҊ��������҂��y(t��ng)��Ŀ�y��ķ������������w�Č��H���Ĕz��e����ԓ���w�ڈD���б��Ĕz�ĈD����e����ֵ���Ķ��ó����C�c���Ĕz���w֮�g�ľ��x������܇܉���h(hu��n)���£����Â��y(t��ng)��Ŀ�y����㷨�y��Ӌ������e�����������������܉��������h(hu��n)������܉��֮�g�ľ��xʼ�K�� 1 435 mm �탞(y��u)�����xӋ��ʽ��ʹ�����Ӻ��������Ľ�(j��ng)�^�����C��ԓϵ�y(t��ng)�܉��� 200 m ��(n��i)��Ч�z�yǰ����܇���x���܉�M�����܉����ͨ��ȫ����Ҫ��

����1 ܉���z�y

�������˫@�������܇��ǰ����Ϣ������܇܇�^���b��һ�����C�����ռ�����ҕ�l��(sh��)��(j��)��ݔ?sh��)�̎���Ԫ�Ќ��D��ָ�ɆΎ��DƬ��Ȼ�����þ��e��(j��ng)�W(w��ng)�j(lu��)(Convolutional Neural Network��CNN)���DƬ�е�܉���M(j��n)����Ч�z�y��ԓ���������ɂ���Ҫ�A�Σ�

����(1)�ڵ�һ�A���У����þ��e��(j��ng)�W(w��ng)�j(lu��)���F(xi��n)܉���h(hu��n)���D������ؼ�������ĵľW(w��ng)�j(lu��)��Ҫ�������a�Ӻͽ�a�ӡ����a�Ӱ��� 3 ��������Ԫ�����Ѓɂ��˞� 3 �Ҳ��L�� 1�ľ��e�Ӻ�һ�����ɘӌӞ�һ��������Ԫ��ͨ�^ 3�����ֵ�ػ��ӵõ�ԭ�D��� 1/8 �ߴ磬Ȼ��ʹ�ÿն����e���������D�ĸ���Ұ���Ķ���܉���M(j��n)����Ч��ȡ����a�ӄtʹ�÷����e�ӣ��� 1/8 �ߴ�������D��߀ԭ��ԭʼ�D��Ĵ�С���ڷ����e�^����߀ԭ�ĈD��քe�c���a�ӽ��ɘ����õ���ͬ�ȳߴ�������DƬ�M(j��n)���ںϣ�����ߙz�y���ȡ�

����(2)�ڶ��A�β��ö�߅�ΔM�Ϸ����탞(y��u)����ȡ��܉��݆��[11-14]�����ɗl܉��ʼ�Kƽ���@һ����������Ч�ą�����Ϣ�탞(y��u)��܉���z�y�Y(ji��)����ͨ�^���e��(j��ng)�W(w��ng)�j(lu��)�����M(j��n)��܉���z�y���քe��ԭʼ�D��͙z�y�D�����ڲɼ��D��ėl�������ƣ����o���ռ�����ͬ����µĈD��(sh��)��(j��)�����Q�@һ���}������ͨ�^�ϳɼ��g(sh��)�ϳ���̓�M�D������ԓ̓�M�D������܉���D���ģ�M��ѩ�����C�˙z�y������ԓ���׃���������ԡ��Y(ji��)��������ԓ܉���z�y������Сѩ(����С��)�l������Ȼ������Ч�ع�����Ȼ�����ڝ��F����������������r�£�ԓ�z�y���������܌��ܵ����ơ�

����2 ���x��ʽ�������Ãɂ�܉��ʼ�Kƽ���@һԭ�t�����H���ԃ�(y��u)��܉���ęz�y��߀�ܺ������x��ʽ��Ӌ�㲽�E������С�׳���ԭ����������������(bi��o)ϵ�����C����(bi��o)ϵ���D������(bi��o)ϵ����������(bi��o)ϵ�Լ� 4 ������(bi��o)ϵ֮�g��ӳ���P(gu��n)ϵ[15-16]��

�����Ԙ�(bi��o)��(zh��n)܉���g��(1 435 mm)����֪��(sh��)��(j��)���ƌ�(d��o)���S�D��Ď��P(gu��n)ϵ���Ķ���(y��u)�����x�y�����ƌ�(d��o)��ʽ�������ڌ��H�У����Ĕz����܇��Ƭ��β��݆������Ҏ(gu��)�t���@��z�y݆���Լ�Ӌ������e�Ĺ������������y��ʹ���о��ˆT�y�ԏ���܇β���õ�����(zh��n)����eֵ�����H��ˣ��S�����x�����ӣ�����������׃�ø���ģ�������Ӝy��ϵ�y(t��ng)�Ĝy��Y(ji��)���`�����ͨ�^������܉���g�̶��ľ��x�탞(y��u)���y��Ӌ��ʽ��ʹ����Ӻ����;��_��

����3 ���C��(bi��o)�����ڙC��ҕ�X�y��ԭ��������(j��)�������C��(bi��o)����[17-18]���ɼ��D��Ĕz��C�ă�(n��i)������(sh��)���ⲿ����(sh��)�M(j��n)�И�(bi��o)�������ȣ������Ȝ�(zh��n)��õ���P���(bi��o)�����M(j��n)���Ĕz��ͨ�^��θ�׃�Ĕzλ�úͽǶȲ�������(bi��o)���D��Ȼ��ͨ�^ OpenCV ��ȡ��P��D��Ľ��c�ԫ@�ø��S��������(bi��o)��Ϣ���Ķ������C�M(j��n)�о���(zh��n)��(bi��o) �� �� Ӌ �� �� �� �C �� ��(n��i) �� �� ��(sh��) [15] ��

����4 ���Y(ji��)�����`�����

������ 1��1 ��܇܉��ģ��̎�����z��C�����ھ��x���� 1.5 m ̎����ʹ��λ�ڃɗl܉�������ġ����˱��C�y���ľ���(zh��n)�ȣ��ڲɼ���(sh��)��(j��)���^������Ҫ�����C�Ĺ��S�c��ƽ��ĊA�ǹ̶���һ��ֵ�ϣ��քe�ڹ��S�cˮƽ��ĊA�Ǟ� 85°��90°�� 95°�Ĕz��һ�M��Ƭ������ 3 �M��Ƭ�M(j��n)��̎��������ÿ�M�ĵ�һ����Ƭ���ھ���܇β�� 40 m ̎�Ĕz��Ȼ��ÿ�������20 m���ٲɼ�һ���D�Ķ��M�ɾ��x��40~200m ̎��һ�M��(sh��)��(j��)�������������㷨���ڹ��S�cˮƽ��ĊA�Ǟ� 90°�r��Ӌ��Ĝy�����x�c���H���x��

���������M(j��n)����Ч�Ĕ�(sh��)��(j��)����������߀�M(j��n)���˶�M���Ռ������S�cˮƽ��ĊA�Ǟ� 85°�� 95°�ľ��x�y�����Y(ji��)��������ͨ�^�C��ҕ�XӋ��õ��ľ��x���ȴ��� 94%�����Ҝy��ÿ���DƬ�ĕr�g�ɱ��� 40 ms �ԃ�(n��i)���ڌ��H�У���܇���ƄӾ��xȡ�Q���S�����أ������ٶȡ�Ħ�������t�r�g���x܇Ƭ���ƄӸס�����λ�á��|(zh��)���ֲ�[17]������(j��)���F·���g(sh��)����Ҏ(gu��)������ֱ���\�еĿ��\��܇�ƄӾ��x��(y��ng)�M������ָ��(bi��o)����ʼ�Ƅ��ٶȞ� 160 km·h-1��200 km·h-1�� 300 km·h-1�r���ƄӾ��x�քeС�� 1 400 m��2 000m �� 3 700 m����ˣ�����(j��)�@ЩҪ�����Ӌ�����܇�ļ��ٶȷքe��-0.70 m·s-2��-0.77 m·s-2 ��-0.94m·s-2��

�����ڳ���܉����ͨ�У���܇���ձ��\���ٶȞ�60 km·h-1���ڵ��F���ƄӼ��ٶȞ�-0.70 m·s-2 �r���ƄӾ��x�_(d��) 200 m ���ҡ���ˣ����F֮�g��(y��ng)ԓ�������� 200 m �ľ��x�Ա�����܇β�����⣬���ڈD��z�y��Ҫ�r�g�ɱ������Ը����\�е���܇�ľ��x�z�y�����ڌ��H�����У���ʹ�Ǯ�(d��ng)ǰ܉����ͨ����ٶȣ�Ҳ�������ٶ� 600 km·h-1���\��r�g 0.04 s�M(j��n)�д��Թ��㡣����(j��)�˔�(sh��)��(j��)�ɵþ��x�z�y�Ĝ�����x<7 m(600 km·h-1×0.04 s =6.7 m)��Ӌ�����g�a(ch��n)���Ĝ�����x����ɵ��`��ͬ�ӝM����܇��ȫ�\�е�Ҫ��

�����C�Ϸ�����֪���a(ch��n)���y���`�����Ҫԭ�����ڃɂ�܉���������cλ�� �����c����������(bi��o)�z�y���ɈD 7 ��ʾ�`�������ʬF(xi��n)��׃��څ�ݿɵã���ǰ����܇���x������܇���xС�r�����ɼ�����܉���DƬ��܉���������������nj��ڙz�y�ɗl܉���������c�t�a(ch��n)���˸����ƫ���(d��o)�¾��x�y���`�����^��;��ǰ����܇���x������܇���x��r���mȻ�D��ķֱ��ʕ��S�����x�����Ӷ����ͣ�����λ �� ���c�ľ��ȅs�S֮׃�ߣ�ʹ���`�������pС;������h(yu��n)�ľ��x�M(j��n)�Йz�y�r���D��ķֱ��ʌ����Y(ji��)����Ӱ푳ɞ���Ҫ���أ���(d��o)���`���ʲ������ߡ�

������ˣ��D��ֱ��ʺ�܉������λ�� �����c�ęz�y���a(ch��n)�����`��M�ώ������`��ӡ���(d��ng)�y���^�������C�ĽǶ�ȫ�̶̹���һ������������(n��i)��ֵ�r�����y��Y(ji��)�����pӰ푿��Ժ��Բ�Ӌ����Ŀ�y��Č����ͨ�^�o�B(t��i)�zӰ���@ȡ�Ĕ�(sh��)��(j��)��������ʹ����ҕ�l��(sh��)��(j��)�У�Ҳ��Ȼ�܉������ȡ�������D�������P(gu��n)�I������ˣ���ԓ�y��ϵ�y(t��ng)��ʹ�õ��o�B(t��i)�D��Ҳ������Ч�C���˷����܉�?q��)��F(xi��n)������܇��ײ��Ч��������C�������ĽY(ji��)Փ�������C�ǶȺ�λ�õ�Ӱ푣�ֻҪ���C�ڔ�(sh��)��(j��)�ɼ��^�����ǹ̶��ģ�ԓ�y��ϵ�y(t��ng)���ٿ����� 200 m ������(n��i)�_(d��)����(bi��o)��(zh��n)��

����5 �Y(ji��)���Z

�������������һ�N���چ�Ŀҕ�X��܉����ͨ���x�y���������M��������܇�v���ƵČ��r��Ҫ��ԓϵ�y(t��ng)������Ч�z�y��܉�����\�е�ǰ����܇֮�g�ľ��x�������x�D(zhu��n)���ɿ�ҕ����Ϣ�ʬF(xi��n)�o�{�T�����{�T�ṩ����̖��ԇ�Y(ji��)������ԓϵ�y(t��ng)�܉�M��܉����ͨ����Ҫ�����C��܇���m�˵Ě��l���°�ȫ�\�С���܉����ͨϵ�y(t��ng)�У����Է���،���֪�̶�܉�����g(1 435 mm)�ľ��x�y���c�����D����Ϣ������һ���M(j��n)���ϵK��z�y�����F(xi��n)����ںϡ�ͬ�r��ԓ����Ҳ�Ǽ�������_(d��)�y�����x�����һ�N�����z�y��

���������īI(xi��n)

����[1] Jung H G,Cho Y H,Yoon P J,et al.Scanning laserradar-based target position designation for parking aidsystem[J].IEEE Transactions on IntelligentTransportation Systems,2008,9(3):406-424.

����[2] Ibisch A,Stefan S,Harald A,et al.Towards autonomousdriving in a parking garage: Vehicle localization andtracking using environment-embedded LIDARsensors[C].Gold Coast:Proceedings of IEEE IntelligentVehicles Symposium,2013.

����[3] Kenue S K.Selection of range and azimuth angleparameters for a forward looking collision warning radarsensor[C]Detroit:Proceedings of the Intelligent Vehicles'95,Symposium,1995.

����[4] Sugimoto S,Tateda H,Takahashi H,et al.Obstacle detectionusing millimeter-wave radar and its visualization onimage sequence[C].Cambridge:Proceedings of theSeventeenth International Conference on PatternRecognition,2004.

�������ߣ����ΘE 1,�� �� 1,2,���� 1

- �n��˼�������У�����̜y�����n�̵Č��`�c˼��

- ���ڔ�(sh��)��(j��)�Y�x�ğo�˙C�y�L��(sh��)��(j��)�����z�y

- ����SWOT�����ĸ��CGJJ���F·�ܽ�(j��ng)���l(f��)չ˼·�c�e��

- ���ڄӑB(t��i)�R��������С����ɽ���(z��i)���ּ��A(y��)��

- ���ڵط�Ʒ�ƽ���(g��u)���l(xi��ng)���Ļ����λ·��

- �����o(h��)������ָ��(bi��o)�ļ���ʽ�˹�����ģ���о�

- ���ڭh(hu��n)�����ܵĽ������ܽK��

- �����ǻۏV늵�ҕ�l���_���O(sh��)

- ����Ƕ��ʽϵ�y(t��ng)��������ܱ��о�չ

SCI�ڿ�Ŀ�

���T�����ڿ�Ŀ�

SCIՓ��

- 2025-04-03Current Science�ڿ�Ͷ���֪

- 2025-04-03�؏�(f��)SCI�����˵IJ��Լ��؏�(f��)�ŵ�

- 2025-04-02Journal of Blood Medicine�t(y��)�W(xu��)4

SSCIՓ��

- 2025-02-28�������о����I(y��)Ӣ��Փ�Ŀ��x��

- 2025-02-19Cogent Education�ڿ��օ^(q��)��Ӱ�

- 2025-02-10��(j��ng)�܌��I(y��)���ٰl(f��)��ssciՓ�ĵ�����

EIՓ��

- 2025-04-02Ҋ����z�����EI���h���]��ƥ��

- 2025-03-05EI���h���İl(f��)Փ�ģ����ָ��(d��o)

- 2025-03-01EI���hՓ��ֵ�ðl(f��)��?2025EI���h

SCOPUS

- 2025-02-07ʲô��ȫ���͔�(sh��)��(j��)��?scopus��(sh��)��(j��)

- 2025-01-24scopus�l(f��)�����¸�ʽ��ָ��

- 2024-11-19Scopus��䛵Ľ���������ڿ�

���g��ɫ

- 2024-11-22���H�����ڿ��l(f��)��Փ�đ�(y��ng)ԓ��ʲô

- 2024-11-22���H���Ľ̎����ڇ��H�����ڿ��l(f��)

- 2024-11-22���H�����ڿ��u�Q���J(r��n)��

�ڿ�֪�R

- 2025-04-01��(f��)�ϲ��ϿƌW(xu��)�c����Փ��Ͷ��word

- 2025-04-01��ȫ����Փ�����]�m��Ͷ�IJ�ͬ��

- 2025-03-2915��������p�����ڿ�!�T���ͣ�

�l(f��)��ָ��(d��o)

- 2025-03-31���x��ͨ��(ji��)���I(l��ng)��Փ���x�}31����

- 2025-03-28��Ӽ��g(sh��)�c���ܼҾ߿Ʌ����īI(xi��n)37

- 2025-03-25늴����䷽���°l(f��)����Փ���īI(xi��n)